L’écosystème technologique de l’intelligence artificielle : guide stratégique pour décideurs

Introduction — Pourquoi l’écosystème IA est devenu critique

L’intelligence artificielle n’est plus une promesse technologique. Elle s’impose désormais comme un levier de transformation majeur, redéfinissant les modèles opérationnels, les chaînes de valeur et les avantages concurrentiels des organisations. Pourtant, cette révolution s’accompagne d’une complexité croissante qui exige des dirigeants une compréhension systémique des enjeux technologiques.

1.1 L’explosion des solutions IA

Le marché de l’intelligence artificielle connaît une croissance exponentielle. Les éditeurs, hyperscalers et startups multiplient les offres : modèles de langage, plateformes d’automatisation, solutions verticales métier, assistants intelligents. Cette prolifération crée une abondance d’opportunités, mais également un risque de confusion stratégique. Les décideurs se trouvent confrontés à un catalogue technologique en expansion permanente, où distinguer l’innovation structurante du simple effet de mode devient un exercice critique.

1.2 Le risque de fragmentation technologique

Sans vision d’ensemble, les organisations accumulent les solutions en silos. Un département adopte un outil de génération de contenu, un autre déploie une plateforme d’analyse prédictive, tandis que l’IT expérimente des modèles de langage sur une infrastructure distincte. Cette fragmentation engendre des redondances, des incompatibilités techniques, une dette technologique croissante et, in fine, une dilution de la valeur attendue. Le coût total de possession explose tandis que les synergies potentielles restent inexploitées.

1.3 L’importance d’une vision écosystème

Adopter une approche écosystémique permet de dépasser cette logique opportuniste. Il s’agit de considérer l’IA non comme une collection d’outils isolés, mais comme un ensemble cohérent de couches technologiques interdépendantes : infrastructure, données, modèles, orchestration, sécurité et usages métiers. Cette vision systémique constitue le socle d’une trajectoire technologique maîtrisée, alignée sur les objectifs stratégiques de l’organisation.

1.4 Le rôle de la veille dans la prise de décision

Dans un environnement technologique aussi dynamique, la veille devient un impératif de gouvernance. Elle ne se limite pas à surveiller les tendances : elle alimente directement les arbitrages d’investissement, les choix d’architecture et la gestion des risques. Une veille structurée permet d’anticiper les ruptures, d’évaluer la maturité des solutions et de sécuriser les décisions technologiques sur le moyen et long terme.

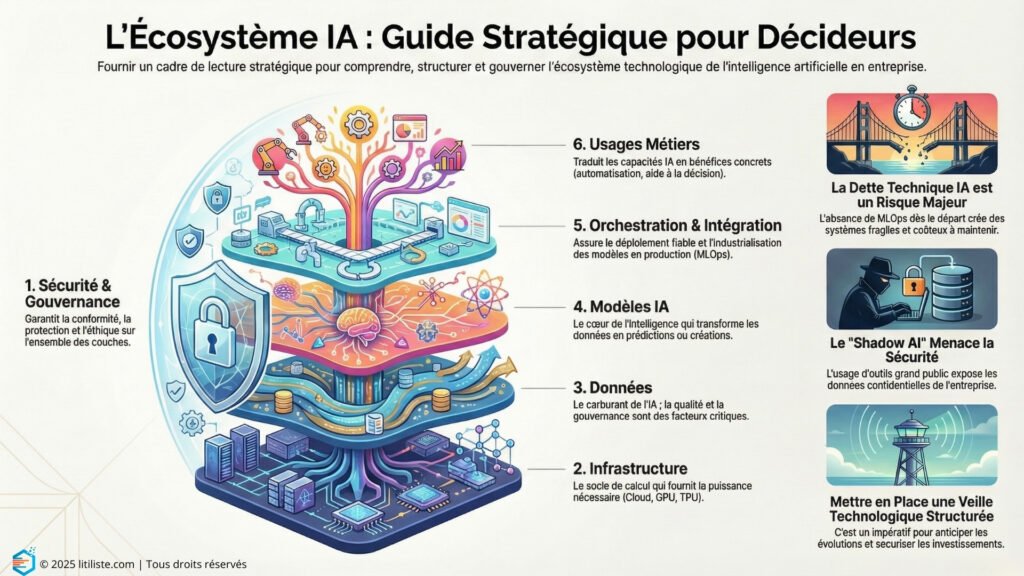

2. Vue d’ensemble de l’écosystème technologique IA

Comprendre l’écosystème IA exige d’en identifier les composantes structurantes et leurs interactions. Cette cartographie fournit aux décideurs un cadre de lecture indispensable pour naviguer dans la complexité technologique.

2.1 Présentation des grandes couches

L’écosystème IA peut être représenté sous forme d’un empilement de couches fonctionnelles, chacune jouant un rôle spécifique dans la chaîne de valeur technologique.

2.1.1 Infrastructure

La couche infrastructure constitue le socle matériel et logiciel sur lequel reposent toutes les capacités IA. Elle englobe les ressources de calcul (CPU, GPU, TPU), le stockage, les réseaux et les environnements d’exécution. Le Cloud public domine aujourd’hui cette couche, bien que les infrastructures hybrides et souveraines gagnent en pertinence.

2.1.2 Données

Les données représentent le carburant de l’intelligence artificielle. Cette couche comprend les systèmes de collecte, de stockage, de transformation et de gouvernance des données. La qualité, l’accessibilité et la conformité des données conditionnent directement la performance des modèles IA.

2.1.3 Modèles IA

La couche des modèles regroupe les algorithmes d’apprentissage automatique, les modèles fondationnels (foundation models), les modèles spécialisés et les outils d’entraînement. Elle constitue le cœur computationnel de l’intelligence artificielle, transformant les données en capacités prédictives, génératives ou décisionnelles.

2.1.4 Orchestration et intégration

Cette couche assure la mise en production, le déploiement et l’intégration des modèles dans les processus métiers. Elle comprend les pipelines MLOps, les API, les connecteurs applicatifs et les plateformes d’orchestration. Sa maturité détermine la capacité de l’organisation à industrialiser ses cas d’usage IA.

2.1.5 Sécurité et gouvernance

Transversale à l’ensemble de l’écosystème, cette couche garantit la conformité réglementaire, la protection des données, la traçabilité des modèles et la gestion des risques. Elle intègre les politiques d’accès, les mécanismes d’audit, les dispositifs de cybersécurité spécifiques à l’IA et les cadres éthiques.

2.1.6 Usages métiers

La couche supérieure concrétise la valeur de l’IA à travers des applications fonctionnelles : automatisation des processus, assistance à la décision, personnalisation client, analyse prédictive, génération de contenu. Elle traduit les capacités technologiques en bénéfices mesurables pour l’organisation.

2.2 Logique d’architecture globale (stack IA)

Ces six couches s’articulent selon une logique verticale où chaque niveau dépend des précédents tout en les enrichissant. L’infrastructure permet le traitement des données, qui alimentent les modèles, lesquels sont orchestrés pour délivrer des usages métiers, le tout encadré par une gouvernance transversale. Cette architecture en stack exige une cohérence d’ensemble : une faiblesse à un niveau se répercute sur les couches supérieures.

3. Cloud et IA

Le Cloud constitue aujourd’hui l’environnement privilégié pour le déploiement des capacités d’intelligence artificielle. Sa flexibilité, sa puissance de calcul et ses services managés en font un accélérateur majeur, mais aussi une source de dépendances stratégiques à évaluer.

3.1 Le rôle du Cloud dans l’IA moderne

L’intelligence artificielle requiert des ressources computationnelles considérables pour l’entraînement des modèles, le traitement de données massives et l’inférence en temps réel. Le Cloud répond à ces exigences en offrant une élasticité que les infrastructures on-premise peinent à garantir. Au-delà du calcul, les plateformes Cloud proposent des services intégrés couvrant l’ensemble du cycle de vie IA : préparation des données, entraînement des modèles, déploiement, monitoring et gouvernance.

3.2 Hyperscalers : positionnement stratégique

Les trois grands hyperscalers dominent le marché du Cloud IA, chacun avec un positionnement distinct.

Amazon Web Services (AWS) s’appuie sur l’exhaustivité de son catalogue et sa maturité opérationnelle. SageMaker constitue sa plateforme phare pour le machine learning, complétée par Bedrock pour l’accès aux modèles fondationnels.

Microsoft Azure capitalise sur son intégration avec l’écosystème Microsoft et son partenariat stratégique avec OpenAI. Azure AI Services et la suite Copilot incarnent cette convergence entre productivité et intelligence artificielle.

Google Cloud Platform (GCP) se distingue par son expertise en recherche IA et ses technologies propriétaires. Vertex AI et les modèles Gemini illustrent cette orientation vers l’innovation algorithmique.

3.3 IA as-a-Service versus IA souveraine

Le recours aux services IA managés des hyperscalers offre rapidité de déploiement et accès aux dernières innovations, mais soulève des questions de souveraineté. Les données sensibles transitent par des infrastructures étrangères, les modèles propriétaires restent des boîtes noires et la dépendance fournisseur s’installe progressivement.

Face à ces enjeux, des alternatives émergent : clouds souverains nationaux ou européens, déploiements on-premise de modèles open source, solutions hybrides permettant de conserver certaines charges de travail critiques en interne. Le choix entre ces options relève d’un arbitrage stratégique entre agilité, coûts, maîtrise des données et conformité réglementaire.

3.4 Enjeux de coûts, scalabilité et dépendance fournisseur

L’adoption du Cloud IA s’accompagne de défis économiques spécifiques. Les coûts d’entraînement et d’inférence peuvent s’avérer considérables, notamment pour les modèles de grande taille. Sans gouvernance FinOps rigoureuse, la facture Cloud peut devenir incontrôlable.

La scalabilité, souvent présentée comme un avantage naturel du Cloud, requiert une architecture pensée pour l’élasticité. Les applications monolithiques ou mal containerisées ne tirent pas pleinement parti de cette flexibilité.

Enfin, la dépendance fournisseur (vendor lock-in) constitue un risque stratégique majeur. Les services propriétaires, les formats de données spécifiques et les intégrations natives créent des coûts de sortie croissants. Une stratégie multi-cloud ou cloud-agnostique peut atténuer ce risque, au prix d’une complexité accrue.

4. DevOps, MLOps et SecOps

L’industrialisation de l’intelligence artificielle exige des pratiques opérationnelles adaptées. Les approches DevOps traditionnelles ne suffisent plus face aux spécificités du machine learning. MLOps et SecOps émergent comme des disciplines indispensables pour déployer l’IA à l’échelle de manière fiable et sécurisée.

4.1 Différence entre DevOps et MLOps

Le DevOps a révolutionné le développement logiciel en fusionnant développement et opérations autour de pipelines d’intégration et de déploiement continus. Cette approche optimise la livraison de code applicatif, mais elle ne couvre pas les particularités du machine learning.

Le MLOps étend ces principes au cycle de vie des modèles IA. Il intègre des préoccupations spécifiques : gestion des données d’entraînement, versionnage des modèles et des expérimentations, monitoring de la dérive des performances (model drift), reproductibilité des résultats. Là où le DevOps gère du code déterministe, le MLOps gère des artefacts probabilistes dont le comportement dépend des données.

4.2 Pourquoi le MLOps est critique pour l’IA à l’échelle

Sans pratiques MLOps structurées, les projets IA restent cantonnés au stade expérimental. Le passage du prototype au déploiement production échoue fréquemment faute de pipelines industrialisés. Les data scientists produisent des modèles performants en laboratoire, mais leur mise en production se heurte à des obstacles d’infrastructure, de monitoring et de maintenance.

Le MLOps répond à ces défis en fournissant un cadre méthodologique et technique pour automatiser l’entraînement, standardiser le déploiement, surveiller les performances en continu et faciliter le réentraînement. Il constitue la clé de voûte de l’IA opérationnelle.

4.3 Intégration de la sécurité (SecOps)

La sécurité ne peut plus être une préoccupation tardive dans les projets IA. Le SecOps intègre les pratiques de sécurité au cœur des pipelines de développement et d’opérations. Dans le contexte de l’intelligence artificielle, cela implique la sécurisation des données d’entraînement, la protection des modèles contre le vol ou la manipulation, le contrôle des accès aux API d’inférence et la détection des usages malveillants.

L’approche DevSecOps, qui fusionne développement, sécurité et opérations, trouve une application naturelle dans le MLOps. Chaque étape du pipeline IA devient un point de contrôle sécuritaire : validation des sources de données, scan des vulnérabilités, chiffrement des artefacts, audit des déploiements.

4.4 Enjeux de fiabilité, traçabilité et conformité

Les réglementations émergentes, notamment l’AI Act européen, imposent des exigences de traçabilité et d’explicabilité pour les systèmes IA à haut risque. Le MLOps fournit les fondations techniques pour répondre à ces obligations : journalisation des expérimentations, documentation automatisée des modèles, conservation des datasets d’entraînement, historique des déploiements.

La fiabilité des systèmes IA en production dépend également de pratiques MLOps matures : tests automatisés, validation des performances avant déploiement, rollback en cas de dégradation, monitoring proactif. Ces mécanismes transforment l’IA expérimentale en composant fiable des systèmes d’information.

5. Data et analytics augmentés par l’IA

Les données constituent le fondement de toute initiative d’intelligence artificielle. Sans données de qualité, même les algorithmes les plus sophistiqués produisent des résultats médiocres. Cette couche mérite une attention stratégique particulière.

5.1 Les données comme fondation de l’IA

L’adage « garbage in, garbage out » prend une dimension critique avec l’intelligence artificielle. Les modèles d’apprentissage automatique capturent les patterns présents dans les données d’entraînement, y compris leurs biais et leurs erreurs. Une stratégie IA performante commence donc par une stratégie data robuste.

Cette fondation implique de cartographier les actifs data de l’organisation, d’évaluer leur qualité et leur accessibilité, d’identifier les lacunes et de définir les priorités de collecte ou d’enrichissement. Les organisations data-driven ne se contentent pas d’accumuler des données : elles les valorisent comme un actif stratégique.

5.2 Data platforms modernes

Les architectures data ont considérablement évolué pour répondre aux exigences de l’IA. Le data warehouse traditionnel cède la place à des plateformes plus flexibles et performantes.

Le data lake centralise les données brutes dans leur format natif, permettant des analyses exploratoires et l’entraînement de modèles sur des volumes massifs. Le data lakehouse combine les avantages du data lake (flexibilité, coût) et du data warehouse (performance, gouvernance) dans une architecture unifiée.

Le data mesh propose une approche décentralisée où chaque domaine métier gère ses propres données comme un produit, tout en respectant des standards d’interopérabilité communs. Cette architecture favorise l’agilité et la responsabilisation des équipes.

Les plateformes data modernes intègrent également des capacités de feature store pour centraliser et réutiliser les caractéristiques préparées pour le machine learning, accélérant ainsi le développement des modèles.

5.3 Analytics augmentés (Augmented Analytics)

L’intelligence artificielle transforme elle-même les pratiques analytiques. Les analytics augmentés désignent l’utilisation de l’IA pour automatiser et enrichir les processus d’analyse de données : préparation automatique des données, détection d’insights, génération de visualisations pertinentes, formulation de requêtes en langage naturel.

Ces capacités démocratisent l’accès aux données en permettant à des utilisateurs non techniques d’explorer et d’interroger les données de manière intuitive. Elles augmentent également la productivité des analystes en automatisant les tâches répétitives.

5.4 Qualité, gouvernance et dette data

La qualité des données reste le talon d’Achille de nombreuses organisations. Données incomplètes, incohérentes, obsolètes ou dupliquées compromettent les initiatives IA avant même leur lancement. Un programme de data quality structuré s’impose, intégrant des règles de validation, des processus de correction et des indicateurs de suivi.

La gouvernance data encadre l’ensemble du cycle de vie des données : définition des rôles et responsabilités, politiques d’accès, gestion des métadonnées, conformité réglementaire (RGPD, réglementations sectorielles). Sans gouvernance, les données prolifèrent de manière anarchique, créant une dette data coûteuse à résorber.

Cette dette data se manifeste par des silos informationnels, des duplications, des définitions incohérentes d’un système à l’autre. Elle ralentit les projets IA, génère des erreurs d’interprétation et mine la confiance dans les analyses. Son traitement exige un effort soutenu de rationalisation et d’harmonisation.

6. Cybersécurité et IA

L’intelligence artificielle et la cybersécurité entretiennent une relation bidirectionnelle. L’IA renforce les capacités de défense, mais elle crée également de nouvelles surfaces d’attaque. Cette dualité exige une approche sécuritaire repensée.

6.1 L’IA comme levier de cybersécurité

Les technologies d’intelligence artificielle transforment les pratiques de cybersécurité. La détection des menaces bénéficie de l’analyse comportementale par machine learning, capable d’identifier des anomalies que les règles statiques ne détectent pas. Les systèmes SIEM (Security Information and Event Management) de nouvelle génération intègrent des capacités d’analyse prédictive pour anticiper les incidents.

L’automatisation des réponses aux incidents, orchestrée par l’IA, réduit les temps de réaction et libère les équipes sécurité des tâches répétitives. La gestion des identités et des accès s’enrichit de mécanismes d’authentification adaptative basés sur l’analyse comportementale.

6.2 L’IA comme surface de risque

Paradoxalement, l’adoption de l’IA élargit la surface d’attaque des organisations. Les modèles de machine learning peuvent être ciblés par des attaques adverses visant à les tromper ou à les détourner. Les données d’entraînement constituent des actifs sensibles dont la compromission aurait des conséquences graves.

Les API d’inférence exposent les modèles à des risques d’extraction (model stealing) ou d’exploitation abusive. Les pipelines MLOps, comme tout système automatisé, présentent des vulnérabilités potentielles dans leurs configurations et leurs dépendances.

6.3 Nouveaux risques spécifiques à l’IA

Plusieurs catégories de risques émergent avec la généralisation de l’IA.

La fuite de données (data leakage) prend une dimension nouvelle avec les modèles génératifs capables de mémoriser et de régurgiter des informations sensibles présentes dans leurs données d’entraînement.

Les attaques par injection de prompt (prompt injection) exploitent les interfaces en langage naturel pour manipuler le comportement des modèles, contourner leurs garde-fous ou extraire des informations confidentielles.

L’empoisonnement des données (data poisoning) vise à corrompre les datasets d’entraînement pour biaiser les prédictions des modèles, une menace particulièrement insidieuse car difficile à détecter.

Les modèles compromis, distribués via des plateformes de partage ou des supply chains mal sécurisées, peuvent embarquer des portes dérobées ou des comportements malveillants.

6.4 Nécessité d’une sécurité by design

Face à ces risques, une approche réactive ne suffit plus. La sécurité doit être intégrée dès la conception des systèmes IA (security by design). Cela implique d’évaluer les risques à chaque étape du cycle de vie : sélection des données, entraînement, déploiement, opération.

Les principes de moindre privilège, de défense en profondeur et de zero trust s’appliquent aux systèmes IA comme aux infrastructures traditionnelles. Des audits de sécurité spécifiques aux modèles (model auditing) complètent les tests de pénétration classiques.

La formation des équipes aux risques IA constitue également un pilier de cette approche. Data scientists, développeurs et utilisateurs métiers doivent comprendre les implications sécuritaires de leurs pratiques.

7. Modern workplace et copilots

L’intelligence artificielle s’invite dans les outils du quotidien, transformant les modes de travail et les interactions homme-machine. Cette évolution promet des gains de productivité substantiels, mais soulève également des défis d’adoption et de gouvernance.

7.1 Intégration de l’IA dans les outils du quotidien

Les suites bureautiques, les plateformes de collaboration, les outils de développement intègrent désormais des fonctionnalités d’intelligence artificielle. Microsoft avec Copilot, Google avec Duet AI, Notion avec ses assistants IA : les éditeurs enrichissent leurs produits de capacités génératives et analytiques.

Cette intégration native réduit la friction d’adoption en évitant aux utilisateurs de basculer vers des outils externes. L’IA devient un compagnon contextuel, disponible au sein même des applications métiers.

7.2 Copilots et assistants intelligents

Le concept de copilot incarne cette nouvelle génération d’assistants. Contrairement aux assistants vocaux précédents, les copilots comprennent le contexte de travail de l’utilisateur, accèdent à ses documents, ses emails, ses historiques. Ils proposent des suggestions proactives, génèrent des contenus, automatisent des tâches répétitives.

Dans le développement logiciel, GitHub Copilot illustre cette transformation en suggérant du code contextuel, accélérant la productivité des développeurs. Des assistants similaires émergent pour la rédaction, l’analyse de données, la gestion de projet, le support client.

7.3 Impacts sur la productivité et les rôles

Les études préliminaires suggèrent des gains de productivité significatifs dans certaines tâches : rédaction, synthèse, codage, analyse de données. Ces gains varient selon les profils, les cas d’usage et la maturité des outils.

Au-delà de la productivité, l’IA redéfinit les rôles et les compétences. Certaines tâches routinières se trouvent automatisées, libérant du temps pour des activités à plus forte valeur ajoutée. Les compétences de collaboration avec l’IA (prompt engineering, validation des outputs, pilotage des assistants) deviennent des atouts professionnels.

Cette évolution nécessite un accompagnement du changement : formation aux nouveaux outils, redéfinition des processus, adaptation des métriques de performance.

7.4 Risques d’usage non maîtrisé (Shadow AI)

L’accessibilité des outils IA grand public crée un phénomène de Shadow AI, analogue au Shadow IT. Les collaborateurs utilisent ChatGPT, Claude ou d’autres services pour leurs tâches professionnelles, souvent sans validation ni encadrement.

Ce phénomène présente plusieurs risques. Les données confidentielles peuvent être exposées à des services tiers non approuvés. La qualité des outputs n’est pas contrôlée, avec des risques d’erreurs ou de biais propagés dans les livrables. La traçabilité des travaux assistés par IA devient impossible.

Une politique d’usage de l’IA claire, combinée à des alternatives approuvées, permet de canaliser ces pratiques tout en conservant l’agilité qu’elles apportent.

8. Veille technologique : méthodes et bonnes pratiques

Dans un écosystème aussi dynamique, la veille technologique devient une compétence organisationnelle stratégique. Elle alimente les décisions d’investissement, anticipe les évolutions et réduit les risques d’obsolescence.

8.1 Pourquoi une veille outillée est indispensable

Le rythme d’innovation en intelligence artificielle dépasse les capacités de suivi informel. De nouveaux modèles, de nouvelles plateformes, de nouvelles réglementations émergent à une cadence accélérée. Sans veille structurée, les organisations naviguent à vue, réagissant aux tendances plutôt que de les anticiper.

Une veille outillée systématise la collecte, l’analyse et la diffusion de l’information technologique. Elle transforme le flux d’actualités en intelligence actionnable pour les décideurs.

8.2 Veille technologique versus veille stratégique

La veille technologique se concentre sur les innovations, les produits, les standards techniques. Elle répond aux questions : quelles technologies émergent ? Quelles solutions mûrissent ? Quels outils deviennent obsolètes ?

La veille stratégique élargit le périmètre aux mouvements de marché, aux positionnements des concurrents, aux évolutions réglementaires. Elle contextualise les informations technologiques dans une perspective business.

Ces deux dimensions se complètent. La veille technologique identifie les opportunités et les risques techniques, la veille stratégique évalue leur pertinence pour l’organisation.

8.3 Indicateurs à suivre

Plusieurs catégories d’indicateurs structurent une veille IA efficace.

Les indicateurs de maturité évaluent le niveau de développement des technologies : stade de R&D, disponibilité commerciale, retours d’expérience, stabilité des API.

Les indicateurs d’adoption mesurent la pénétration des solutions sur le marché : parts de marché, tendances de téléchargement, mentions dans les offres d’emploi, références clients.

Les indicateurs de ROI compilent les études de cas, les benchmarks de performance, les analyses coût-bénéfice publiées par les analystes ou les utilisateurs.

Les indicateurs de risque surveillent les vulnérabilités découvertes, les incidents de sécurité, les controverses éthiques, les évolutions réglementaires potentiellement contraignantes.

8.4 Rôle des décideurs, PMO et directions IT

La veille technologique ne peut rester l’apanage d’une fonction isolée. Elle irrigue plusieurs niveaux de l’organisation.

Les directions IT et les architectes d’entreprise exploitent la veille pour orienter les choix techniques, définir les standards et anticiper les évolutions d’architecture.

Les PMO intègrent les informations de veille dans la gestion du portefeuille de projets, évaluant la pertinence des initiatives au regard des tendances technologiques.

Les dirigeants utilisent la veille comme input stratégique, alimentant les réflexions sur les modèles d’affaires, les investissements et les partenariats.

Cette diffusion implique des formats adaptés : synthèses exécutives pour les dirigeants, analyses techniques approfondies pour les architectes, alertes ciblées pour les chefs de projet.

9. Synthèse exécutive

L’écosystème technologique de l’intelligence artificielle représente à la fois une opportunité stratégique et un défi de gouvernance. Cette synthèse condense les enseignements clés pour les décideurs.

9.1 Messages clés à retenir

L’IA n’est pas une technologie isolée mais un écosystème de couches interdépendantes. La performance d’une initiative IA dépend de la maturité de chaque couche, de l’infrastructure aux usages métiers.

La donnée reste le facteur limitant principal. Sans stratégie data structurée, les investissements IA produisent des rendements décevants.

L’industrialisation distingue les expérimentations des déploiements à valeur. Le MLOps constitue la discipline clé pour franchir ce cap.

La sécurité IA exige une approche spécifique. Les risques classiques de cybersécurité se combinent avec des menaces propres aux systèmes apprenants.

L’adoption par les utilisateurs conditionne le retour sur investissement. Les copilots et assistants ne délivrent leur valeur que si les pratiques de travail évoluent.

9.2 Opportunités stratégiques

L’automatisation intelligente des processus permet des gains d’efficacité substantiels sur les tâches répétitives et codifiables.

L’augmentation des capacités humaines, via les assistants et les analytics augmentés, renforce la productivité et la qualité des décisions.

La personnalisation à l’échelle transforme l’expérience client et ouvre de nouveaux modèles de revenus.

L’optimisation prédictive, dans la maintenance, la supply chain ou la gestion des risques, génère des économies mesurables.

9.3 Zones de vigilance

La dette technique IA s’accumule rapidement si les pratiques MLOps ne sont pas mises en place dès les premiers projets.

La dépendance aux hyperscalers crée des risques de lock-in et de souveraineté qu’il convient d’évaluer explicitement.

Le Shadow AI expose l’organisation à des fuites de données et des risques de conformité.

La pénurie de compétences limite la capacité d’exécution et crée une vulnérabilité aux départs clés.

La conformité réglementaire, avec l’AI Act notamment, impose des exigences croissantes de documentation, de traçabilité et d’explicabilité.

9.4 Recommandations de gouvernance technologique

Définir une stratégie IA alignée sur les priorités business, identifiant les cas d’usage à fort impact et les capacités à développer.

Établir une gouvernance transverse impliquant IT, métiers, sécurité et juridique dans les arbitrages technologiques.

Investir dans les fondations data avant de multiplier les expérimentations IA.

Structurer les pratiques MLOps dès les premiers projets pour éviter l’accumulation de dette technique.

Encadrer les usages IA par une politique claire, des formations adaptées et des outils approuvés.

Organiser une veille technologique structurée, alimentant régulièrement les instances de décision.

10. Bonus — Cadre de lecture

10.1 Cartographie simplifiée de l’écosystème IA

┌─────────────────────────────────────────────────────────────────────┐

│ USAGES MÉTIERS │

│ Automatisation · Aide à la décision · Personnalisation · Copilots │

├─────────────────────────────────────────────────────────────────────┤

│ SÉCURITÉ & GOUVERNANCE │

│ Conformité · Éthique · Traçabilité · Gestion des risques │

├─────────────────────────────────────────────────────────────────────┤

│ ORCHESTRATION & INTÉGRATION │

│ MLOps · API Management · Pipelines · Monitoring │

├─────────────────────────────────────────────────────────────────────┤

│ MODÈLES IA │

│ Foundation Models · ML/DL · Entraînement · Fine-tuning │

├─────────────────────────────────────────────────────────────────────┤

│ DONNÉES │

│ Data Platforms · Feature Store · Qualité · Gouvernance │

├─────────────────────────────────────────────────────────────────────┤

│ INFRASTRUCTURE │

│ Cloud · GPU/TPU · Stockage · Réseau · Environnements │

└─────────────────────────────────────────────────────────────────────┘

10.2 Checklist de veille technologique IA

Sources à surveiller

- Publications des hyperscalers (AWS, Azure, GCP)

- Rapports analystes (Gartner, Forrester, IDC)

- Conférences majeures (NeurIPS, ICML, Google I/O, Microsoft Build)

- Revues académiques et preprints (arXiv)

- Blogs techniques des éditeurs et communautés open source

- Évolutions réglementaires (AI Act, CNIL, autorités sectorielles)

Processus de veille

- Définir les thématiques prioritaires alignées sur la stratégie

- Identifier les sources pertinentes par thématique

- Organiser la collecte automatisée (agrégateurs, alertes)

- Planifier les revues périodiques (hebdomadaire, mensuelle)

- Produire des synthèses adaptées aux audiences

- Diffuser vers les instances de décision

- Évaluer l’impact des informations sur le portefeuille projets

Indicateurs de veille

- Nombre de technologies suivies par niveau de maturité

- Alertes critiques identifiées et traitées

- Décisions influencées par la veille

- Couverture des thématiques stratégiques

10.3 Grille d’aide à la décision pour choisir une technologie IA

| Critère | Questions clés | Pondération suggérée |

|---|---|---|

| Alignement stratégique | La technologie répond-elle à un cas d’usage prioritaire ? S’inscrit-elle dans la trajectoire IT ? | Élevée |

| Maturité | Quel est le niveau de stabilité ? Existe-t-il des retours d’expérience probants ? | Élevée |

| Intégration | La solution s’intègre-t-elle au SI existant ? Quels sont les efforts d’interfaçage ? | Moyenne à élevée |

| Compétences | Les équipes disposent-elles des compétences requises ? Quel effort de montée en compétence ? | Moyenne |

| Coût total | Quels sont les coûts d’acquisition, d’intégration, d’opération et de sortie ? | Moyenne à élevée |

| Scalabilité | La solution supporte-t-elle la montée en charge prévue ? | Moyenne |

| Sécurité | Les exigences de sécurité et de conformité sont-elles satisfaites ? | Élevée |

| Réversibilité | Quel est le niveau de dépendance fournisseur ? Quelles alternatives existent ? | Moyenne |

| Support écosystème | La communauté est-elle active ? Le support éditeur est-il fiable ? | Moyenne |

| Évolutivité | La roadmap produit est-elle alignée avec les besoins futurs ? | Moyenne |

Méthodologie d’utilisation

- Lister les solutions candidates répondant au besoin fonctionnel

- Évaluer chaque solution sur les critères (note de 1 à 5)

- Appliquer les pondérations selon le contexte projet

- Calculer les scores pondérés et établir un classement

- Approfondir l’analyse des solutions les mieux classées

- Documenter la décision et ses justifications

Mots-clés

écosystème IA, intelligence artificielle entreprise, stratégie IA, transformation digitale, MLOps, Cloud IA, gouvernance IA, cybersécurité IA, data platform, veille technologique, copilot IA, modern workplace, architecture IA, AI Act, hyperscalers, analytics augmentés, Shadow AI, industrialisation IA, modèles fondationnels, décideurs IT