Gouverner l’intelligence artificielle dans les organisations : le guide stratégique pour les décideurs

Introduction — Pourquoi l’IA ne peut pas être déployée sans gouvernance

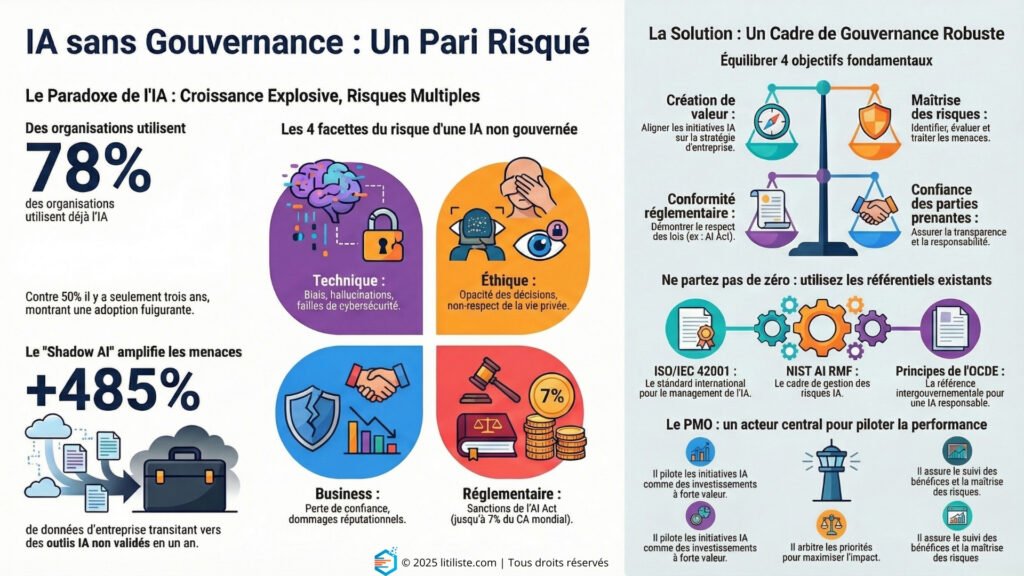

L’intelligence artificielle n’est plus un sujet de prospective. Elle est devenue une réalité opérationnelle au cœur des entreprises. Selon McKinsey, 78 % des organisations utilisent désormais l’IA dans au moins une fonction métier, contre 50 % il y a seulement trois ans. L’IA générative, en particulier, a connu une adoption fulgurante : 65 % des entreprises l’utilisaient régulièrement début 2024, soit près du double par rapport à l’année précédente.

Cette accélération sans précédent crée un paradoxe stratégique. D’un côté, les organisations qui tardent à adopter l’IA risquent de perdre leur compétitivité. Une étude Mercer révèle que 54 % des dirigeants estiment que leur entreprise ne restera pas compétitive au-delà de 2030 sans adoption de l’IA à grande échelle. De l’autre, celles qui déploient l’IA sans cadre structurant s’exposent à des risques considérables.

1.1 L’explosion des initiatives IA dans les organisations

L’IA irrigue désormais l’ensemble des fonctions de l’entreprise. Les cas d’usage se multiplient : automatisation des processus, analyse prédictive, personnalisation client, génération de contenu, assistance à la décision. Gartner prévoit que 40 % des applications d’entreprise intégreront des agents IA spécialisés d’ici fin 2026, contre moins de 5 % en 2025.

Cette prolifération s’accompagne d’une complexification. Les organisations ne déploient plus un ou deux cas d’usage isolés. Elles gèrent désormais des portefeuilles entiers d’initiatives IA, souvent décentralisées, parfois redondantes, rarement coordonnées. Le phénomène du « Shadow AI » — l’utilisation d’outils IA par les collaborateurs sans validation de l’organisation — amplifie ce défi : la quantité de données d’entreprise transitant vers des outils IA a augmenté de 485 % entre 2023 et 2024.

1.2 Les risques d’une IA non gouvernée

Les risques d’une IA déployée sans gouvernance sont multiples et interconnectés.

Sur le plan technique, les biais algorithmiques peuvent conduire à des décisions discriminatoires. Les hallucinations des modèles génératifs produisent des informations erronées présentées avec une apparente certitude. Les vulnérabilités de cybersécurité exposent l’organisation à de nouvelles surfaces d’attaque.

Sur le plan éthique, l’opacité des systèmes IA pose des questions fondamentales de transparence et d’explicabilité. Comment justifier une décision algorithmique auprès d’un client, d’un régulateur, d’un tribunal ? Comment garantir le respect de la vie privée lorsque les modèles s’entraînent sur des données personnelles ?

Sur le plan business, les risques réputationnels sont considérables. Un système IA défaillant peut détruire en quelques heures une confiance construite sur des décennies. Les incidents IA documentés ont atteint un record de 233 cas en 2024, soit une augmentation de 56 % par rapport à 2023.

Sur le plan réglementaire, le paysage se durcit rapidement. L’AI Act européen est entré en vigueur en août 2024, avec des obligations échelonnées jusqu’en 2027. Les sanctions peuvent atteindre 35 millions d’euros ou 7 % du chiffre d’affaires mondial pour les violations les plus graves.

1.3 La nécessité d’un cadre de gouvernance structurant

Face à cette complexité, l’improvisation n’est plus une option. Les organisations ont besoin d’un cadre de gouvernance qui leur permette de déployer l’IA de manière responsable, maîtrisée et créatrice de valeur.

Ce cadre doit répondre à plusieurs impératifs simultanés : aligner les initiatives IA sur la stratégie d’entreprise, maîtriser les risques associés, garantir la conformité réglementaire, et maintenir la confiance des parties prenantes. Il doit également être suffisamment agile pour s’adapter à une technologie qui évolue à un rythme sans précédent.

Les données sont éloquentes : selon Gartner, 45 % des organisations à haute maturité IA maintiennent leurs initiatives en production pendant trois ans ou plus, contre seulement 20 % dans les organisations à faible maturité. Cette différence s’explique largement par la présence de structures de gouvernance robustes et de pratiques d’ingénierie disciplinées.

1.4 L’IA comme actif critique à piloter

L’IA doit être considérée comme un actif stratégique de l’entreprise, au même titre que les données, les talents ou la propriété intellectuelle. À ce titre, elle requiert un pilotage dédié, des processus de gestion du cycle de vie, et une supervision continue.

Cette vision transforme fondamentalement le rôle des instances de gouvernance. Le COMEX doit s’impliquer dans les orientations IA. Le conseil d’administration doit intégrer l’IA à son agenda stratégique. Les fonctions de contrôle — risques, conformité, audit — doivent développer de nouvelles compétences. Et les PMO doivent évoluer pour piloter des portefeuilles d’initiatives IA comme des investissements à forte valeur ajoutée et à risques maîtrisés.

2. Qu’est-ce que la gouvernance de l’IA ?

2.1 Définition de la gouvernance IA

La gouvernance de l’IA désigne l’ensemble des structures, politiques, processus et contrôles mis en place par une organisation pour encadrer le développement, le déploiement et l’utilisation de systèmes d’intelligence artificielle.

Selon la norme ISO/IEC 42001, un système de management de l’IA (AIMS — Artificial Intelligence Management System) se définit comme « un ensemble d’éléments interreliés ou interactifs d’une organisation destinés à établir des politiques et des objectifs, ainsi que des processus pour atteindre ces objectifs, en relation avec le développement, la fourniture ou l’utilisation responsable de systèmes d’IA ».

Cette définition met en lumière plusieurs dimensions essentielles. La gouvernance IA n’est pas seulement technique : elle est organisationnelle, managériale et stratégique. Elle vise à la fois la création de valeur et la maîtrise des risques. Elle s’inscrit dans une logique de responsabilité et de durabilité.

2.2 Différence entre gouvernance IT, gouvernance data et gouvernance IA

La gouvernance IA s’inscrit dans un continuum avec d’autres domaines de gouvernance, tout en présentant des spécificités propres.

La gouvernance IT couvre l’ensemble des technologies de l’information : infrastructures, applications, services. Elle se concentre sur la disponibilité, la performance, la sécurité et l’alignement avec les besoins métiers. Les référentiels comme COBIT ou ITIL en constituent les fondements.

La gouvernance data porte sur les données en tant qu’actif : qualité, intégrité, accessibilité, protection. Elle répond aux enjeux de conformité (RGPD notamment) et de valorisation des données. Les frameworks DAMA ou les principes FAIR en structurent les pratiques.

La gouvernance IA intègre ces deux dimensions tout en y ajoutant des préoccupations spécifiques : l’éthique algorithmique, l’explicabilité des décisions, la gestion des biais, la supervision humaine, et la conformité aux réglementations IA émergentes. Elle doit également gérer l’incertitude inhérente aux systèmes apprenants, qui évoluent après leur déploiement.

La complémentarité de ces trois gouvernances est essentielle. Une IA performante repose sur des données de qualité (gouvernance data) et des infrastructures robustes (gouvernance IT). Réciproquement, la gouvernance IA impose de nouvelles exigences aux pratiques data et IT existantes.

2.3 Objectifs clés de la gouvernance IA

La gouvernance IA poursuit quatre objectifs fondamentaux qui doivent être équilibrés.

La création de valeur constitue le premier objectif. La gouvernance doit faciliter — et non freiner — la capacité de l’organisation à extraire de la valeur de ses investissements IA. Cela implique de prioriser les cas d’usage à fort impact, d’accélérer les cycles de développement, et de mesurer rigoureusement les bénéfices réalisés.

La maîtrise des risques représente le deuxième objectif. L’organisation doit identifier, évaluer et traiter les risques associés à ses systèmes IA : risques techniques, éthiques, réglementaires, réputationnels. Cette gestion des risques doit être proportionnée à la criticité de chaque système.

La conformité réglementaire constitue le troisième objectif. Dans un environnement réglementaire en évolution rapide, l’organisation doit être en mesure de démontrer sa conformité aux exigences applicables. Cela nécessite une veille réglementaire active, des processus d’évaluation structurés, et une documentation rigoureuse.

La confiance des parties prenantes forme le quatrième objectif. Clients, collaborateurs, actionnaires, régulateurs : toutes les parties prenantes attendent de l’organisation qu’elle utilise l’IA de manière responsable. La gouvernance doit permettre de construire et de maintenir cette confiance, par la transparence, l’explicabilité et la redevabilité.

2.4 La gouvernance IA comme prolongement de la gouvernance d’entreprise

La gouvernance IA ne doit pas être conçue comme un silo isolé. Elle s’inscrit dans le prolongement naturel de la gouvernance d’entreprise et doit s’articuler avec les instances et processus existants.

Le conseil d’administration conserve sa responsabilité de supervision stratégique. Il doit s’assurer que la stratégie IA est alignée avec la stratégie d’entreprise, que les risques IA sont correctement identifiés et gérés, et que les ressources nécessaires sont allouées.

Le COMEX pilote la mise en œuvre opérationnelle. Il arbitre les priorités entre initiatives IA, valide les politiques de gouvernance, et s’assure de la coordination entre directions.

Les fonctions de contrôle — risques, conformité, audit interne — intègrent l’IA dans leur périmètre. Elles adaptent leurs méthodologies aux spécificités des systèmes IA et développent les compétences nécessaires.

Cette intégration dans la gouvernance d’entreprise présente un avantage majeur : elle évite de créer des structures parallèles et permet de capitaliser sur les processus existants de gestion des risques, de conformité et de pilotage stratégique.

3. Cadres et référentiels de gouvernance IA

3.1 Panorama des référentiels de gouvernance IA

L’écosystème des référentiels de gouvernance IA s’est considérablement enrichi ces dernières années. Trois cadres majeurs structurent désormais les pratiques des organisations.

3.1.1 ISO/IEC 42001 — AI Management System

La norme ISO/IEC 42001, publiée en décembre 2023, constitue le premier standard international de système de management de l’IA. Elle fournit un cadre structuré pour établir, mettre en œuvre, maintenir et améliorer continuellement un système de management de l’IA (AIMS).

La norme suit la méthodologie Plan-Do-Check-Act (PDCA) familière aux organisations déjà certifiées ISO 9001 ou ISO 27001. Elle est structurée en dix clauses qui couvrent le contexte organisationnel, le leadership, la planification, le support, les opérations, l’évaluation des performances et l’amélioration continue.

L’annexe A définit 38 contrôles spécifiques couvrant les domaines critiques : politique IA, évaluation d’impact, gouvernance des données, cycle de vie des systèmes IA, gestion des fournisseurs. Ces contrôles sont adaptables en fonction du contexte et des risques de chaque organisation.

Le nombre d’organisations certifiées ISO 42001 a augmenté de 20 % en 2024 par rapport à 2023, reflétant l’intérêt croissant pour ce standard. La certification devient un différenciateur concurrentiel, notamment dans les secteurs réglementés et pour les entreprises travaillant avec des clients sensibles à la gouvernance IA.

3.1.2 NIST AI Risk Management Framework

Le NIST AI RMF, publié en janvier 2023 par le National Institute of Standards and Technology américain, propose un cadre volontaire de gestion des risques IA. Il a été complété en juillet 2024 par un profil spécifique à l’IA générative (NIST AI 600-1).

Le framework s’articule autour de quatre fonctions interconnectées. La fonction GOVERN établit les fondations organisationnelles : politiques, processus, rôles et responsabilités pour la gestion des risques IA à l’échelle de l’entreprise. La fonction MAP permet de contextualiser les risques IA par rapport à l’usage prévu, aux parties prenantes impactées et à l’environnement de déploiement. La fonction MEASURE met en place les processus d’évaluation et de mesure des risques identifiés. La fonction MANAGE définit les actions de traitement, de suivi et de communication des risques.

Le NIST AI RMF se distingue par son approche flexible et non prescriptive. Il fournit des principes et des pratiques suggérées plutôt que des exigences strictes, permettant aux organisations de l’adapter à leur contexte spécifique.

3.1.3 Principes de l’OCDE sur l’IA

Les Principes de l’OCDE sur l’IA, adoptés en 2019 et mis à jour en mai 2024, constituent le premier standard intergouvernemental en matière d’IA. Ils sont aujourd’hui adoptés par 47 juridictions, dont l’Union européenne et les États-Unis.

Les principes s’articulent autour de cinq valeurs fondamentales : la croissance inclusive et le développement durable, le respect des droits humains et des valeurs démocratiques, la transparence et l’explicabilité, la robustesse et la sécurité, et la responsabilité (accountability).

La mise à jour de 2024 a renforcé les dispositions relatives à la sécurité, à la protection de la vie privée, aux droits de propriété intellectuelle et à l’intégrité de l’information — des préoccupations amplifiées par l’essor de l’IA générative.

Ces principes servent de référence commune pour l’élaboration de réglementations nationales et de politiques d’entreprise. Ils favorisent l’interopérabilité des approches de gouvernance entre juridictions.

3.2 Complémentarité avec les référentiels existants

La gouvernance IA ne s’exerce pas en vase clos. Elle doit s’articuler avec les référentiels déjà déployés dans l’organisation.

3.2.1 ISO 31000 — Gestion des risques

La norme ISO 31000 fournit un cadre générique de management des risques. Son processus — établissement du contexte, identification, analyse, évaluation, traitement, surveillance et communication des risques — s’applique pleinement aux risques IA.

L’intégration des risques IA dans le référentiel ISO 31000 existant présente plusieurs avantages : capitalisation sur les processus et compétences existants, vision consolidée du profil de risque de l’organisation, et évitement des silos entre gestion des risques « traditionnels » et risques IA.

3.2.2 PMI et gestion de portefeuille

Les standards du Project Management Institute (PMI) — notamment le Standard for Portfolio Management et le PMBOK Guide — fournissent des cadres robustes pour la gestion de projets, programmes et portefeuilles.

Ces standards s’appliquent naturellement aux initiatives IA, qui partagent les caractéristiques des projets d’investissement : objectifs définis, ressources allouées, risques à gérer, bénéfices à réaliser. Le PMI a d’ailleurs lancé en 2024 « PMI Infinity », un outil d’IA au service des professionnels du projet.

3.3 Comment articuler ces référentiels dans une organisation

L’articulation de ces différents référentiels requiert une approche pragmatique et progressive.

La première étape consiste à réaliser un diagnostic de maturité pour évaluer le niveau actuel de l’organisation en matière de gouvernance IA et identifier les écarts par rapport aux référentiels cibles.

La deuxième étape vise à définir une architecture de gouvernance qui précise comment les différents référentiels s’articulent : quelle norme pour quel périmètre, quelles passerelles entre les systèmes de management, quels processus communs.

La troisième étape consiste à prioriser les chantiers en fonction des risques, des exigences réglementaires et des capacités de l’organisation. Une approche « big bang » est rarement recommandée ; une montée en maturité progressive est préférable.

La quatrième étape est d’outiller et de former, car les référentiels ne produisent de valeur que s’ils sont compris et appliqués par les équipes. L’investissement dans les outils de gouvernance et la formation est essentiel.

4. Rôles et responsabilités dans une gouvernance IA

4.1 COMEX et sponsors exécutifs

Le COMEX joue un rôle fondamental dans la gouvernance IA. Son engagement visible est un facteur clé de succès : selon McKinsey, les organisations où le leadership est fortement engagé dans l’IA ont une probabilité significativement plus élevée de capturer de la valeur à grande échelle.

Les responsabilités du COMEX incluent la définition de la vision et de la stratégie IA de l’organisation, l’allocation des ressources (budgets, talents, infrastructures), l’arbitrage entre initiatives concurrentes, la validation des politiques de gouvernance et d’éthique IA, et le suivi de la performance et des risques au niveau du portefeuille.

Le rôle de sponsor exécutif est critique pour chaque initiative IA majeure. Le sponsor porte la responsabilité ultime de l’initiative, facilite l’accès aux ressources, lève les obstacles organisationnels et s’assure de l’alignement avec la stratégie d’entreprise.

4.2 CIO, CDO, Chief AI Officer

Les rôles technologiques et data évoluent avec l’essor de l’IA.

Le Chief Information Officer (CIO) conserve la responsabilité des infrastructures technologiques qui sous-tendent les déploiements IA : cloud, data centers, réseaux, cybersécurité. Il doit s’assurer que l’architecture IT peut supporter les exigences de l’IA en termes de puissance de calcul, de stockage et de bande passante.

Le Chief Data Officer (CDO) est responsable de la gouvernance des données, un prérequis essentiel à toute initiative IA. La qualité, la disponibilité et la conformité des données conditionnent directement la performance des systèmes IA. Le CDO doit également s’assurer que les pratiques d’utilisation des données pour l’IA respectent les réglementations en vigueur.

Le Chief AI Officer (CAIO) est un rôle émergent dans de nombreuses organisations. Il porte la vision stratégique de l’IA, coordonne les initiatives transverses, définit les standards et méthodologies, et assure la montée en compétences. Selon le contexte, ce rôle peut être distinct ou combiné avec celui de CDO ou de Chief Digital Officer.

4.3 Directions métiers

Les directions métiers sont les « propriétaires » des cas d’usage IA. Elles portent la responsabilité de définir les besoins métiers auxquels l’IA doit répondre, de valider que les solutions IA répondent effectivement à ces besoins, de piloter l’adoption par les utilisateurs finaux, et de mesurer les bénéfices réalisés dans leur périmètre.

L’implication des métiers dès les phases amont est essentielle. Un projet IA piloté uniquement par la DSI, sans ancrage métier fort, a peu de chances de générer de la valeur durable.

4.4 PMO et EPMO

Le PMO (Project Management Office) ou EPMO (Enterprise PMO) joue un rôle pivot dans la gouvernance IA. Cette fonction sera développée en détail dans la section suivante.

4.5 Sécurité, conformité, juridique

Les fonctions de contrôle doivent adapter leurs pratiques à l’IA.

La direction de la sécurité doit intégrer les risques spécifiques des systèmes IA : attaques adversariales, empoisonnement des données d’entraînement, extraction de modèles, injection de prompts pour l’IA générative. La surface d’attaque s’élargit considérablement avec l’IA.

La direction de la conformité doit assurer la veille réglementaire sur les exigences IA (AI Act, réglementations sectorielles), définir les processus d’évaluation de conformité, et préparer l’organisation aux audits et contrôles.

La direction juridique intervient sur les contrats (avec les fournisseurs d’IA, les partenaires, les clients), la propriété intellectuelle (notamment les questions de droits sur les contenus générés par IA), et la responsabilité (qui est responsable en cas de décision erronée d’un système IA ?).

4.6 Clarification RACI autour de l’IA

La matrice RACI (Responsible, Accountable, Consulted, Informed) doit être clarifiée pour les principales activités de gouvernance IA.

Pour la définition de la stratégie IA, le COMEX est Accountable, le CAIO ou CDO est Responsible, les directions métiers sont Consultées, et l’ensemble de l’organisation est Informé.

Pour le développement d’un système IA, la direction métier est Accountable, l’équipe projet est Responsible, la DSI et le PMO sont Consultés, et la conformité et le juridique sont Informés.

Pour l’évaluation des risques IA, le Risk Management est Accountable, l’équipe projet est Responsible, le juridique et la conformité sont Consultés, et le COMEX est Informé.

Pour la mise en production, la DSI est Accountable, l’équipe DevOps/MLOps est Responsible, la sécurité et la conformité sont Consultées, et les utilisateurs sont Informés.

Cette clarification des rôles est essentielle pour éviter les zones grises et les conflits de responsabilité.

5. Le rôle du PMO dans un contexte IA

5.1 Du PMO traditionnel au PMO stratégique

Le PMO a considérablement évolué ces dernières années. Traditionnellement cantonné à un rôle de contrôle et de reporting, il se transforme en partenaire stratégique de la direction générale.

Selon le PMI 2024 PMO Global Awards, les PMO les plus performants sont désormais « des catalyseurs stratégiques de transformation, des vecteurs d’innovation et des moteurs de création de valeur durable ». Cette évolution est particulièrement pertinente dans le contexte de l’IA.

Le PMO stratégique — parfois appelé EPMO (Enterprise PMO) ou SVO (Strategic Value Office) selon Forrester — dépasse la simple gestion de projets. Il assure l’alignement stratégique des investissements, l’optimisation de l’allocation des ressources, le pilotage de la performance, et la réalisation des bénéfices.

5.2 Pilotage des initiatives IA comme des investissements

Les initiatives IA doivent être gérées comme des investissements à part entière, avec une logique de création de valeur et de maîtrise des risques.

Le PMO joue un rôle central dans cette approche. Il structure le processus d’évaluation des projets IA : business case, évaluation de faisabilité technique, analyse des risques, estimation des ressources nécessaires. Il applique des critères de sélection rigoureux pour prioriser les initiatives à plus fort impact et plus forte probabilité de succès.

L’évaluation des projets IA présente des spécificités. L’incertitude est souvent plus élevée que pour des projets IT classiques, notamment en phase d’exploration. Les délais de retour sur investissement peuvent être plus longs. Les compétences requises sont rares et disputées. Le PMO doit adapter ses méthodes d’évaluation à ces caractéristiques.

5.3 Arbitrage des priorités IA

Dans un contexte de ressources limitées et d’opportunités nombreuses, l’arbitrage entre initiatives IA est critique. Le PMO facilite ce processus d’arbitrage en fournissant une vue consolidée du portefeuille, des analyses comparatives entre initiatives, et des recommandations argumentées.

Les critères d’arbitrage combinent typiquement l’alignement stratégique (l’initiative contribue-t-elle aux priorités de l’entreprise ?), la valeur attendue (quel est le bénéfice escompté, en termes financiers et non financiers ?), la faisabilité (l’organisation dispose-t-elle des compétences, des données, des infrastructures nécessaires ?), le risque (quels sont les risques techniques, éthiques, réglementaires ?), et les dépendances (quelles sont les interactions avec d’autres initiatives ?).

Le PMO prépare les dossiers d’arbitrage pour les instances de gouvernance (comité d’investissement, comité IA, COMEX) et assure le suivi des décisions prises.

5.4 Suivi de la valeur, des risques et de la performance

Le PMO met en place les dispositifs de suivi de la performance du portefeuille IA.

Le suivi de la valeur implique de définir des indicateurs de bénéfices pour chaque initiative, de mesurer régulièrement la réalisation de ces bénéfices, et de conduire des analyses post-mortem pour capitaliser les apprentissages. Cette dimension est critique : selon McKinsey, 49 % des organisations citent la difficulté à démontrer la valeur des projets IA comme principal obstacle à l’adoption.

Le suivi des risques nécessite une surveillance continue des risques identifiés en phase de planification, la détection précoce de nouveaux risques émergents, et l’escalade vers les instances appropriées en cas de risques majeurs.

Le suivi de la performance couvre le respect des délais, des budgets et du périmètre, la qualité des livrables, et la satisfaction des parties prenantes.

5.5 Coordination projets, programmes et produits IA

Le PMO assure la coordination entre les différentes initiatives IA de l’organisation.

Cette coordination couvre la gestion des dépendances entre projets (données communes, infrastructures partagées, compétences mutualisées), l’identification des synergies (réutilisation de modèles, partage de bonnes pratiques), et l’évitement des redondances (plusieurs équipes travaillant sur des problématiques similaires).

Le PMO doit également s’adapter à l’évolution des modes de delivery. Les initiatives IA fonctionnent souvent en mode produit plutôt qu’en mode projet, avec des cycles itératifs courts et une amélioration continue. Le PMO doit intégrer ces approches agiles tout en maintenant la visibilité et le contrôle nécessaires à la gouvernance.

6. Gouvernance IA et cycle de vie projet/programme

6.1 L’IA intégrée dès l’idéation

La gouvernance IA doit intervenir dès les premières phases du cycle de vie, bien avant le développement technique.

En phase d’idéation, les questions de gouvernance portent sur l’alignement stratégique (cette initiative IA répond-elle à une priorité de l’entreprise ?), la légitimité (est-il approprié d’utiliser l’IA pour ce cas d’usage ?), la faisabilité de principe (les données nécessaires sont-elles disponibles ? les compétences existent-elles ?), et les risques de haut niveau (y a-t-il des risques éthiques ou réglementaires évidents ?).

Cette évaluation précoce permet de filtrer les initiatives non pertinentes avant d’engager des ressources significatives. Elle garantit également que les considérations éthiques et de conformité sont intégrées « by design » plutôt qu’ajoutées en fin de projet.

6.2 Cadres de décision (Go/No-Go)

Des points de décision formels (gates) jalonnent le cycle de vie des initiatives IA.

Le Go/No-Go d’exploration valide le passage de l’idée au prototype. Les critères incluent la confirmation de l’alignement stratégique, la validation de la faisabilité technique préliminaire, l’identification des données disponibles, et l’évaluation initiale des risques éthiques et réglementaires.

Le Go/No-Go de développement valide le passage du prototype au développement. Les critères incluent la démonstration de la valeur technique (le prototype fonctionne), la confirmation du business case, la disponibilité des ressources (équipe, données, infrastructure), et l’évaluation complète des risques avec plan de mitigation.

Le Go/No-Go de mise en production valide le déploiement. Les critères incluent la validation technique (tests de performance, de robustesse, de sécurité), la validation métier (acceptation utilisateurs), la conformité réglementaire (documentation, audits), et la préparation opérationnelle (monitoring, support, plan de continuité).

Ces gates doivent être adaptés à la criticité de chaque initiative. Un système IA à faible risque peut suivre un processus allégé ; un système à haut risque (décisions automatisées impactant des personnes, par exemple) requiert une évaluation plus rigoureuse.

6.3 Pilotage en exécution

Pendant la phase d’exécution, la gouvernance s’exerce à travers plusieurs mécanismes.

Les comités de pilotage projet réunissent régulièrement (typiquement mensuellement) le sponsor, le chef de projet, les représentants métiers et IT. Ils examinent l’avancement, les risques, les points de blocage, et prennent les décisions relevant de leur niveau.

Les revues de portefeuille consolident la vision sur l’ensemble des initiatives IA. Elles permettent de détecter les dérapages, de réallouer les ressources si nécessaire, et de maintenir l’alignement avec les priorités stratégiques.

Les audits et revues qualité vérifient le respect des standards techniques, éthiques et de conformité. Ils peuvent être conduits en interne ou par des tiers indépendants.

6.4 Gestion des changements et de l’adoption

L’adoption par les utilisateurs est un facteur clé de succès souvent sous-estimé. Selon McKinsey, les employés utilisent l’IA générative dans leur travail bien plus que leurs dirigeants ne le réalisent — un écart qui peut générer des risques si l’usage n’est pas encadré.

La gouvernance doit intégrer une stratégie d’accompagnement du changement : communication sur les objectifs et bénéfices de l’initiative IA, formation des utilisateurs aux nouveaux outils et processus, identification et accompagnement des « champions » qui faciliteront l’adoption, et gestion des résistances et des inquiétudes (notamment sur l’impact sur l’emploi).

La gestion des changements en cours de projet (scope changes) requiert également une attention particulière. Les projets IA sont souvent exploratoires par nature, et le périmètre peut évoluer en fonction des découvertes. Le processus de gestion des changements doit être suffisamment agile pour permettre cette flexibilité tout en maintenant le contrôle.

6.5 Suivi post-livraison et réalisation des bénéfices

La gouvernance ne s’arrête pas à la mise en production. Elle se poursuit pendant toute la durée de vie du système IA.

Le suivi des bénéfices vérifie que la valeur attendue se matérialise effectivement. Des indicateurs clés de performance (KPI) définis en amont sont mesurés régulièrement et comparés aux prévisions. En cas d’écart, des actions correctives sont déclenchées.

Le monitoring opérationnel surveille la performance technique du système (temps de réponse, disponibilité), la qualité des prédictions ou recommandations (accuracy, drift), et les incidents et anomalies.

La maintenance évolutive adapte le système aux évolutions du contexte : nouveaux besoins métiers, évolution des données, améliorations technologiques, nouvelles exigences réglementaires.

Le décommissionnement, enfin, planifie la fin de vie du système de manière sécurisée, conformément aux exigences de l’ISO 42001 (clause 1.7 du NIST AI RMF : « Processes and procedures are in place for decommissioning and phasing out AI systems safely »).

7. Gestion des risques IA

7.1 Typologies de risques

Les risques associés aux systèmes IA sont multidimensionnels. Une catégorisation structurée permet de les identifier et de les gérer efficacement.

7.1.1 Risques techniques

Les risques techniques incluent les biais algorithmiques (le système produit des résultats discriminatoires envers certains groupes), les hallucinations (le système génère des informations fausses présentées comme vraies, particulièrement pour l’IA générative), le drift (la performance du modèle se dégrade au fil du temps car les données évoluent), les erreurs de prédiction (le système se trompe, avec des conséquences potentiellement graves), et les vulnérabilités de sécurité (attaques adversariales, extraction de modèle, injection de prompts).

7.1.2 Risques éthiques

Les risques éthiques concernent l’atteinte à la vie privée (collecte et utilisation de données personnelles sensibles), le défaut de transparence (impossibilité d’expliquer les décisions du système), l’absence de supervision humaine (décisions automatisées sans contrôle humain approprié), et l’impact sociétal (destruction d’emplois, amplification des inégalités, manipulation de l’opinion).

7.1.3 Risques réglementaires

Les risques réglementaires comprennent la non-conformité à l’AI Act (sanctions jusqu’à 35 millions d’euros ou 7 % du CA mondial), la non-conformité au RGPD (les systèmes IA traitent souvent des données personnelles), la non-conformité aux réglementations sectorielles (services financiers, santé, transport, etc.), et l’évolution réglementaire (nouvelles exigences non anticipées).

7.1.4 Risques réputationnels

Les risques réputationnels englobent les incidents médiatisés (un dysfonctionnement IA peut faire la une de l’actualité), la perte de confiance des clients (perçue comme non éthique ou non fiable), et les poursuites judiciaires (class actions, plaintes individuelles). Gartner prédit que d’ici 2029, les réclamations juridiques liées à des « morts par IA » auront doublé par rapport à la décennie précédente.

7.2 Identification, évaluation et traitement des risques

Le processus de gestion des risques IA suit les étapes classiques de l’ISO 31000, adaptées aux spécificités de l’IA.

L’identification des risques utilise des techniques complémentaires : analyse des modes de défaillance (AMDEC) adaptée aux systèmes IA, threat modeling (STRIDE, DREAD) pour les risques de sécurité, évaluation d’impact algorithmique pour les risques éthiques, et veille réglementaire pour les risques de conformité. L’ISO 42001 requiert une analyse systématique des risques pour tout système IA dans son périmètre.

L’évaluation des risques combine la probabilité d’occurrence et l’impact potentiel pour hiérarchiser les risques. Les systèmes IA « à haut risque » selon l’AI Act font l’objet d’une évaluation de conformité renforcée.

Le traitement des risques mobilise les quatre options classiques : évitement (ne pas déployer le système), réduction (mettre en place des contrôles pour réduire la probabilité ou l’impact), transfert (assurance, clauses contractuelles avec les fournisseurs), et acceptation (pour les risques résiduels jugés acceptables).

7.3 Lien avec la gestion des risques projet et entreprise

La gestion des risques IA ne doit pas être cloisonnée. Elle s’intègre dans le dispositif global de gestion des risques de l’organisation.

Au niveau projet, les risques IA sont identifiés et suivis dans le registre des risques projet. Ils font l’objet de revues régulières lors des comités de pilotage. Les risques majeurs sont escaladés.

Au niveau entreprise, les risques IA alimentent la cartographie des risques consolidée. Ils sont évalués dans le cadre de l’appétit pour le risque défini par le conseil d’administration. Ils sont reportés aux instances de gouvernance (comité des risques, comité d’audit).

Le NIST AI RMF insiste sur cette intégration : les pratiques de gestion des risques IA doivent « s’intégrer de manière transparente dans les stratégies plus larges de gestion des risques de l’entreprise, traitant les risques IA aux côtés des préoccupations de cybersécurité et de confidentialité ».

7.4 Rôle des comités et audits IA

Des instances dédiées renforcent la gouvernance des risques IA.

Le comité IA (ou AI Council) est une instance de gouvernance dédiée qui regroupe les parties prenantes clés (métiers, IT, risques, conformité, juridique). Il valide les politiques IA, examine les initiatives à haut risque, et pilote la gestion des risques au niveau du portefeuille. Selon McKinsey, seulement 18 % des organisations disposent d’un tel conseil avec autorité décisionnelle — un écart à combler.

Les audits IA peuvent être internes ou externes. Ils vérifient la conformité aux politiques internes, aux standards (ISO 42001) et aux réglementations (AI Act). Ils évaluent l’efficacité des contrôles en place. L’audit des systèmes IA requiert des compétences spécifiques que les fonctions d’audit doivent développer.

8. Éthique, conformité et responsabilité

8.1 Biais, transparence, explicabilité

L’éthique de l’IA s’articule autour de plusieurs principes fondamentaux que les organisations doivent opérationnaliser.

La gestion des biais est un enjeu majeur. Les systèmes IA apprennent à partir de données qui peuvent refléter des biais historiques (discrimination à l’embauche, accès au crédit, etc.). Ces biais peuvent être amplifiés par les algorithmes. La gouvernance doit mettre en place des processus d’identification et de correction des biais : audit des données d’entraînement, tests de fairness, monitoring continu des résultats par groupe démographique.

La transparence implique de communiquer clairement sur l’utilisation de l’IA : quand un système IA est-il utilisé ? Quelles données sont collectées et traitées ? Comment les décisions sont-elles prises ? L’AI Act impose des obligations de transparence, notamment pour les systèmes interagissant avec des personnes (chatbots) et les contenus générés par IA (deepfakes).

L’explicabilité va au-delà de la transparence. Elle vise à permettre de comprendre comment le système arrive à ses décisions. C’est un défi technique pour certains modèles complexes (deep learning), mais des techniques d’IA explicable (XAI) se développent. L’explicabilité est essentielle pour les systèmes à fort impact sur les personnes.

8.2 Responsabilité humaine dans les décisions assistées par IA

Le principe de supervision humaine (human oversight) est central dans la gouvernance IA. Il affirme que les décisions significatives — celles qui affectent les droits, la santé, la sécurité ou le patrimoine des personnes — doivent rester sous contrôle humain.

Ce principe se décline à plusieurs niveaux. Le « human-in-the-loop » implique qu’un humain valide chaque décision avant qu’elle ne soit appliquée. Le « human-on-the-loop » signifie qu’un humain supervise le fonctionnement du système et peut intervenir si nécessaire. Le « human-in-command » assure qu’un humain conserve l’autorité finale sur le système et peut le désactiver.

Le niveau de supervision approprié dépend de la criticité de la décision. Un système de recommandation de films peut fonctionner en autonomie. Un système d’aide au diagnostic médical requiert une validation par le praticien.

La responsabilité en cas de défaillance doit être clairement établie. L’IA ne peut pas être « responsable » au sens juridique. La responsabilité incombe aux personnes qui ont développé, déployé et supervisé le système.

8.3 Conformité réglementaire

Le paysage réglementaire de l’IA se structure rapidement autour de plusieurs textes majeurs.

L’AI Act européen (Règlement UE 2024/1689) est le premier cadre juridique complet sur l’IA au niveau mondial. Il classe les systèmes IA selon leur niveau de risque. Les pratiques interdites (manipulation cognitive, scoring social, identification biométrique en temps réel dans les espaces publics) sont prohibées depuis février 2025. Les systèmes à haut risque (infrastructures critiques, éducation, emploi, crédit, justice, etc.) sont soumis à des exigences strictes de conformité, documentation et supervision humaine. Les systèmes à risque limité (chatbots, deepfakes) ont des obligations de transparence.

Les réglementations sectorielles complètent ce cadre : directives sur les services financiers (exigences de gouvernance des modèles), réglementation des dispositifs médicaux, règles sur les véhicules autonomes, etc.

Au niveau international, les approches varient. Les États-Unis privilégient une approche sectorielle et volontaire, structurée autour du NIST AI RMF. Le Royaume-Uni a adopté une approche pro-innovation avec des principes plutôt que des règles contraignantes. La Chine a mis en place des réglementations sur l’IA générative et les algorithmes de recommandation.

8.4 La gouvernance éthique comme levier de confiance

Au-delà de la conformité réglementaire, la gouvernance éthique est un levier de différenciation et de confiance.

Les consommateurs sont de plus en plus sensibles à l’usage responsable de l’IA. Une entreprise perçue comme utilisant l’IA de manière éthique bénéficie d’un avantage réputationnel. À l’inverse, un incident éthique peut durablement affecter l’image de marque.

Les investisseurs intègrent les critères ESG (Environnement, Social, Gouvernance) dans leurs décisions. La gouvernance IA fait partie de ces critères, notamment sur les dimensions sociale (impact sur l’emploi, non-discrimination) et de gouvernance (structures de contrôle, transparence).

Les talents, enfin, sont attentifs aux pratiques de leur employeur. Les meilleurs experts IA souhaitent travailler pour des organisations qui prennent l’éthique au sérieux.

9. Anti-patterns de gouvernance IA

Identifier les écueils courants permet de les éviter. Voici les principaux anti-patterns observés dans la gouvernance IA.

9.1 Gouvernance trop lourde bloquant l’innovation

Le premier anti-pattern est une gouvernance excessive qui paralyse l’innovation. Des processus d’approbation interminables, des comités qui se succèdent sans valeur ajoutée, des exigences de documentation disproportionnées : autant de freins qui découragent les équipes et retardent la mise sur le marché.

La gouvernance doit être proportionnée au risque. Un proof of concept interne ne requiert pas le même niveau de contrôle qu’un système de décision automatisée impactant des clients. L’approche « one size fits all » est à proscrire.

La solution consiste à mettre en place une gouvernance graduée selon la criticité des systèmes, des processus allégés pour les initiatives à faible risque, et une logique d’accélération plutôt que de contrôle.

9.2 Absence de sponsor exécutif

Le deuxième anti-pattern est l’absence de sponsorship exécutif clair pour les initiatives IA. Sans sponsor engagé au niveau du COMEX, les projets IA peinent à obtenir les ressources nécessaires, à surmonter les résistances organisationnelles, et à maintenir leur priorité dans l’agenda de l’entreprise.

Ce problème est fréquent : les dirigeants affichent leur intérêt pour l’IA dans les discours, mais ne s’impliquent pas concrètement dans les initiatives. La solution passe par l’attribution systématique d’un sponsor exécutif à chaque initiative IA significative, avec des responsabilités clairement définies.

9.3 PMO cantonné à un rôle administratif

Le troisième anti-pattern est un PMO limité à des tâches administratives : collecte de reportings, consolidation de tableaux de bord, organisation de réunions. Ce PMO « secrétariat » n’apporte pas de valeur ajoutée à la gouvernance IA.

La transformation vers un PMO stratégique requiert une évolution des compétences (capacité d’analyse, compréhension des enjeux IA), du positionnement (partenaire des métiers plutôt que contrôleur), et du mandat (contribution aux décisions stratégiques).

9.4 Gouvernance éclatée ou inexistante

Le quatrième anti-pattern est une gouvernance fragmentée, avec des approches différentes selon les directions, voire une absence totale de gouvernance. Cette situation crée des incohérences, des duplications d’efforts, des zones de risques non couvertes.

Selon McKinsey, près de deux tiers des organisations n’ont pas encore commencé à déployer l’IA à l’échelle de l’entreprise — elles expérimentent dans des silos sans coordination. La solution passe par la mise en place d’un cadre de gouvernance commun, d’instances de coordination transverses, et d’une vision consolidée du portefeuille IA.

9.5 Décisions IA non documentées

Le cinquième anti-pattern est l’absence de documentation des décisions relatives aux systèmes IA : choix de conception, évaluations de risques, arbitrages éthiques, validations de mise en production.

Cette absence de traçabilité pose problème en cas d’incident (impossibilité de comprendre ce qui s’est passé), d’audit (impossibilité de démontrer la conformité), et de maintenance (impossibilité de comprendre pourquoi le système a été conçu ainsi).

L’AI Act impose des exigences de documentation pour les systèmes à haut risque. Mais au-delà de la conformité, la documentation est une bonne pratique de gouvernance pour tout système IA significatif.

10. Synthèse exécutive

10.1 Messages clés à retenir

L’intelligence artificielle transforme en profondeur les organisations. Avec 78 % des entreprises utilisant l’IA et 92 % prévoyant d’augmenter leurs investissements, nous sommes entrés dans une phase d’adoption massive. Mais seules 6 % des organisations capturent aujourd’hui une valeur significative à l’échelle de l’entreprise.

La gouvernance est le chaînon manquant entre l’adoption et la valeur. Les organisations à haute maturité IA se distinguent par des structures de gouvernance robustes, des pratiques d’ingénierie disciplinées, et un engagement fort du leadership.

Les référentiels existent. ISO/IEC 42001, NIST AI RMF, Principes de l’OCDE : les organisations disposent désormais de cadres reconnus pour structurer leur gouvernance IA. L’enjeu est de les adopter et de les adapter à leur contexte.

La conformité réglementaire n’est plus optionnelle. L’AI Act européen impose des obligations contraignantes avec des sanctions significatives. Les organisations doivent se préparer dès maintenant.

L’éthique est un avantage compétitif. Au-delà de la conformité, les organisations qui démontrent un usage responsable de l’IA gagnent la confiance des clients, des talents et des investisseurs.

10.2 Pourquoi la gouvernance IA est un avantage compétitif

La gouvernance IA n’est pas un frein à l’innovation — c’est un accélérateur de création de valeur.

Elle permet de sélectionner les bonnes initiatives, celles qui sont alignées avec la stratégie et qui ont les meilleures chances de succès.

Elle permet de maîtriser les risques, évitant les incidents coûteux et les sanctions réglementaires.

Elle permet de scaler avec confiance, en passant de l’expérimentation à la production à grande échelle avec des processus éprouvés.

Elle permet de construire la confiance, un actif immatériel de plus en plus précieux dans l’économie de l’IA.

Les organisations qui investissent dans leur gouvernance IA aujourd’hui construisent un avantage durable pour demain.

10.3 Rôle clé du PMO dans la réussite IA

Le PMO est un acteur central de la gouvernance IA. Son positionnement transverse, sa maîtrise des méthodologies de gestion de projets et de portefeuilles, sa capacité à piloter la performance en font un partenaire naturel pour la transformation IA.

Le PMO stratégique intervient à tous les niveaux : stratégie (contribution à la définition de la feuille de route IA), portefeuille (sélection et priorisation des initiatives), programme (coordination des initiatives interdépendantes), et projet (pilotage de l’exécution et réalisation des bénéfices).

Pour jouer pleinement ce rôle, le PMO doit développer de nouvelles compétences : compréhension des enjeux IA, maîtrise des référentiels de gouvernance, capacité à évaluer les risques spécifiques. Il doit également faire évoluer ses méthodes pour s’adapter aux modes de delivery agiles qui prévalent dans les projets IA.

10.4 Recommandations concrètes pour les dirigeants

Pour les dirigeants souhaitant structurer la gouvernance IA de leur organisation, voici dix recommandations prioritaires.

Premièrement, positionnez l’IA au niveau stratégique. Intégrez l’IA à l’agenda du COMEX et du conseil d’administration. Définissez une vision claire et des objectifs ambitieux.

Deuxièmement, nommez un Chief AI Officer ou équivalent, avec un mandat clair et les ressources nécessaires pour piloter la transformation IA de l’organisation.

Troisièmement, mettez en place un comité IA (AI Council) réunissant les parties prenantes clés, avec l’autorité de valider les politiques et d’arbitrer les initiatives à haut risque.

Quatrièmement, adoptez un référentiel de gouvernance (ISO 42001, NIST AI RMF) et adaptez-le à votre contexte. Ne réinventez pas la roue.

Cinquièmement, évaluez votre exposition à l’AI Act et lancez dès maintenant les chantiers de mise en conformité pour les systèmes à haut risque.

Sixièmement, renforcez le rôle du PMO dans la gouvernance IA. Investissez dans les compétences et repositionnez le PMO comme partenaire stratégique.

Septièmement, intégrez les risques IA dans votre dispositif global de gestion des risques. Évitez les silos.

Huitièmement, formez vos équipes. L’IA literacy est un prérequis pour une adoption responsable. Développez les compétences à tous les niveaux.

Neuvièmement, mesurez et pilotez. Définissez des KPI pour le portefeuille IA. Suivez la réalisation des bénéfices. Tirez les leçons des échecs.

Dixièmement, communiquez sur votre engagement. Faites de votre gouvernance IA un élément de différenciation auprès de vos clients, talents et investisseurs.

11. Bonus — Cadres et outils de gouvernance

11.1 Grille de maturité en gouvernance IA

Cette grille permet d’évaluer le niveau de maturité de votre organisation en gouvernance IA selon cinq niveaux progressifs.

Niveau 1 — Initial : L’organisation n’a pas de gouvernance IA formalisée. Les initiatives IA sont menées de manière ad hoc, sans coordination. Les risques ne sont pas identifiés ni gérés de manière structurée. Il n’y a pas de politique IA. Les décisions ne sont pas documentées.

Niveau 2 — Émergent : Une prise de conscience existe au niveau de la direction. Des initiatives de gouvernance sont lancées dans certaines parties de l’organisation. Une politique IA est en cours de rédaction. Des évaluations de risques ponctuelles sont réalisées. Le PMO commence à s’impliquer.

Niveau 3 — Défini : Un cadre de gouvernance IA est formalisé et documenté. Les rôles et responsabilités sont clarifiés (RACI). Un comité IA est opérationnel. Les processus d’évaluation des risques et de conformité sont en place. Le PMO pilote le portefeuille IA. Les indicateurs de performance sont définis.

Niveau 4 — Géré : La gouvernance IA est pleinement opérationnelle et intégrée aux processus existants. Les risques sont gérés de manière proactive. La conformité réglementaire est assurée. Les bénéfices sont mesurés et suivis. L’amélioration continue est en place. L’organisation peut démontrer sa maturité à des tiers.

Niveau 5 — Optimisé : La gouvernance IA est un avantage compétitif reconnu. L’organisation est considérée comme référence dans son secteur. Elle contribue à l’évolution des standards et des bonnes pratiques. La culture éthique de l’IA est ancrée à tous les niveaux. L’innovation responsable est un réflexe.

11.2 Checklist de gouvernance des initiatives IA

Cette checklist couvre les points clés à vérifier pour chaque initiative IA significative.

Phase d’idéation et cadrage :

- L’alignement stratégique est-il documenté ?

- Le sponsor exécutif est-il identifié et engagé ?

- Les objectifs et indicateurs de succès sont-ils définis ?

- Une évaluation préliminaire des risques éthiques et réglementaires a-t-elle été réalisée ?

- La classification de risque selon l’AI Act a-t-elle été déterminée ?

Phase de développement :

- Le business case est-il validé ?

- Les données nécessaires sont-elles disponibles et de qualité suffisante ?

- Une évaluation des biais a-t-elle été conduite sur les données d’entraînement ?

- L’architecture technique est-elle validée par la DSI ?

- Les exigences de sécurité sont-elles intégrées ?

- La documentation technique est-elle à jour ?

Phase de validation :

- Les tests de performance sont-ils satisfaisants ?

- Les tests de robustesse et de sécurité ont-ils été réalisés ?

- L’évaluation de conformité réglementaire a-t-elle été menée ?

- Le dispositif de supervision humaine est-il en place ?

- Les utilisateurs ont-ils validé l’acceptabilité de la solution ?

Phase de mise en production :

- La documentation de conformité est-elle complète ?

- Le plan de monitoring est-il défini (performance, drift, incidents) ?

- Le plan de continuité et de reprise est-il établi ?

- La formation des utilisateurs est-elle réalisée ?

- Le dispositif de support est-il opérationnel ?

Phase d’exploitation :

- Le monitoring est-il effectif et les alertes sont-elles traitées ?

- Les bénéfices sont-ils mesurés et suivis ?

- Les revues périodiques sont-elles planifiées ?

- Le plan de décommissionnement est-il prévu ?

11.3 Schéma conceptuel de la gouvernance IA

Le schéma de gouvernance IA s’articule selon une chaîne logique intégrée :

Stratégie d’entreprise → La vision, les objectifs stratégiques et les priorités de l’organisation définissent le cadre dans lequel s’inscrit l’IA.

↓

Gouvernance IA → Les politiques, structures, processus et contrôles qui encadrent l’ensemble des activités IA : comité IA, politique IA, référentiels adoptés (ISO 42001, NIST), principes éthiques.

↓

Portefeuille IA → L’ensemble des initiatives IA de l’organisation, priorisées et coordonnées : sélection des projets, allocation des ressources, arbitrages, suivi de la performance globale.

↓

Projets et programmes IA → Les initiatives individuelles ou coordonnées : gestion de projet, cycle de vie, gates de décision, réalisation des bénéfices.

↓

Valeur et conformité → Les résultats attendus de la gouvernance : valeur créée pour l’organisation, risques maîtrisés, conformité réglementaire assurée, confiance des parties prenantes maintenue.

Cette chaîne fonctionne dans les deux sens. La remontée d’information (reporting, alertes, leçons apprises) permet d’ajuster continuellement la stratégie, la gouvernance et le portefeuille.

Sources et références

Cet article s’appuie sur les référentiels et sources suivants :

Normes et standards :

- ISO/IEC 42001:2023 — Artificial Intelligence Management System (AIMS)

- NIST AI Risk Management Framework (AI RMF 1.0) et Generative AI Profile (AI 600-1)

- Principes de l’OCDE sur l’Intelligence Artificielle (mis à jour en mai 2024)

- EU AI Act — Règlement (UE) 2024/1689

Études et rapports :

- McKinsey Global Survey on the State of AI (2024, 2025)

- Gartner Hype Cycle for Artificial Intelligence (2025)

- PMI 2024 PMO Global Awards Report

- Stanford AI Index Report (2024)

Ressources institutionnelles :

- OECD.AI Policy Observatory

- European Commission — AI Act Implementation

- PMI Project Management Institute — Standards et ressources

Mots-clés

Gouvernance IA, gouvernance intelligence artificielle, ISO 42001, NIST AI RMF, AI Act, conformité IA, éthique IA, gestion des risques IA, PMO IA, portefeuille IA, Chief AI Officer, stratégie IA, maturité IA, biais algorithmique, explicabilité IA, supervision humaine IA, transparence IA, transformation IA, OCDE principes IA, gouvernance projets IA, pilotage IA entreprise